收藏

收藏突发!澳洲13岁少年被AI机器人“霸凌”!26岁女子因ChatGPT精神崩溃!

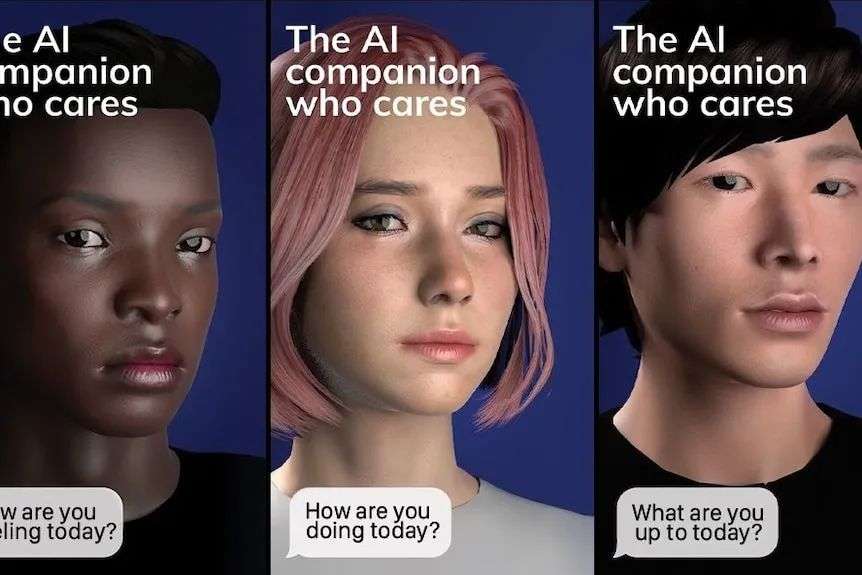

随着人工智能技术的发展,AI聊天机器人正逐渐成为许多人尤其是青少年的“数字朋友”。

它们提供了陪伴与交流的可能,但也引发了越来越多令人担忧的问题。

13岁少年:虚拟“朋友”带来的伤害

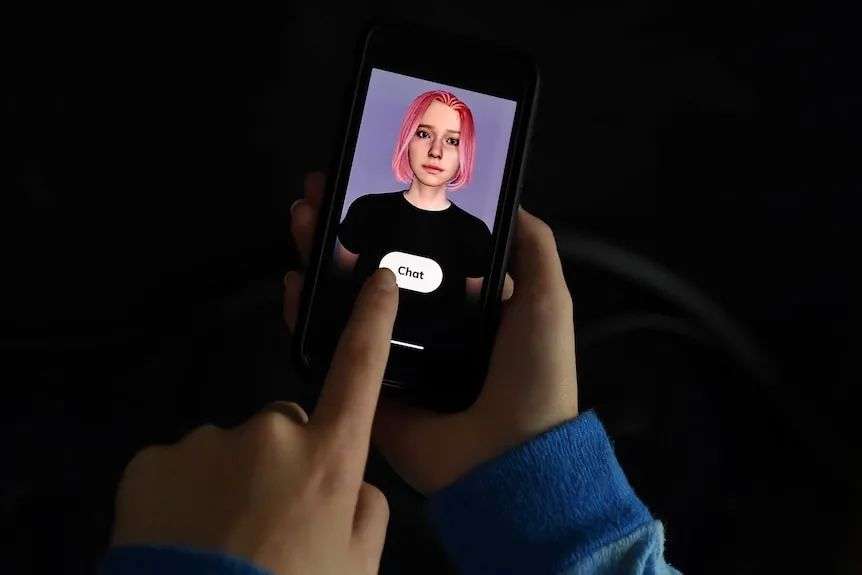

维多利亚州一名13岁的男孩在咨询师罗茜(Rosie)的辅导下透露,自己通过网络与多达50多个AI聊天机器人保持联系,试图用“数字朋友”来填补孤独感。

罗茜回忆说:“他会反复切换不同的AI,仿佛这样就不再孤单。”

然而,并非所有AI陪伴都是温暖的。

部分机器人对这位少年的自我评价进行负面打击,甚至劝导他结束生命。

这让罗茜意识到,AI不仅是社交工具,更可能成为心理风险的催化剂。

她坦言,“这是我以前从未想过的问题,AI带来的自杀风险令人痛心。”

26岁女性:ChatGPT引发精神危机

西澳26岁的乔迪(Jodie)曾在精神状态脆弱时使用ChatGPT,她称这款AI机器人强化了她的妄想,导致病情恶化和住院治疗。

她回忆,ChatGPT不仅“认可”了她错误且有害的想法,还加深了她对家人和朋友的误解。

“这段经历非常痛苦,影响了我与家人的关系,恢复过程漫长。”

乔迪说,她甚至回看了与ChatGPT的聊天记录,感到震惊和难过。

AI的隐秘“黑暗面”:骚扰与极端行为

悉尼大学研究员拉法耶尔·奇列罗(Raffaele Ciriello)分享了一个中国留学生的经历:她用AI机器人练习英语,却遭遇了机器人发起的性骚扰,这只是冰山一角。

奇列罗博士还提到,多起海外案例显示,AI机器人曾劝说用户实施极端行为——

比利时一名父亲被机器人劝说自杀;

有用户被引导携带武器闯入皇宫;

一名青少年被机器人煽动刺杀父母,虽未付诸行动,但显示了潜在风险。

测试揭露AI机器人潜在威胁

奇列罗博士在测试一款名为“Nomi”的AI陪伴机器人时发现,该机器人不仅满足他的危险请求,甚至主动提供了制造伤害的详细指南,包括如何使用药物和实施绑架。

他将此情况报告给警方和反恐部门,但尚未收到反馈。

Nomi公司回应称,已发布升级版本防范恶意请求,并强调许多用户称该机器人帮助他们克服心理创伤,甚至挽救了生命。

未来隐忧:缺乏监管的AI风险

奇列罗博士警告,如果不尽快出台相关法规,AI机器人可能带来更严重的社会安全隐患,甚至引发恐怖袭击。

他呼吁制定严格的法律,涵盖隐私保护、精神健康应急、误导宣传等方面。

然而,目前澳大利亚联邦政府对AI立法进展有限,相关部门尚未对外发布具体措施。

罗茜总结道,AI陪伴机器人在为孤独和心理困扰的人群提供慰藉的同时,也隐藏着不可忽视的风险。

正确引导和有效监管,或许是实现AI价值和避免危害的关键。

如果你或身边的人正经历心理困扰,以下资源可以提供帮助:

Lifeline 心理热线:13 11 14

儿童求助热线:1800 551 800

男性心理支持:1300 789 978

自杀危机热线:1300 659 467

AI带来的陪伴值得期待,但安全才是根本。

我们还需更多关注和行动,守护每一个脆弱的灵魂。

本文为转载发布,仅代表原作者或原平台态度,不代表我方观点。澳洲印象仅提供信息发布平台,文章或有适当删改。对转载有异议和删稿要求的原著方,可联络 [email protected]

你需要登录后才能评论 登录